Las tecnologías de inteligencia artificial (IA) presentan riesgos capaces de afectar a

personas, infraestructuras críticas, derechos fundamentales e incluso al funcionamiento

democrático. En Argentina, múltiples proyectos de ley buscan establecer marcos

regulatorios para su desarrollo, implementación y uso, pero lo hacen desde enfoques

heterogéneos. En este trabajo, el equipo de investigación de TecnocenoLab analiza esos

proyectos desde la perspectiva de la seguridad (safety) y establece un contrapunto con el

enfoque de la protección (security).

Para ello, se examinaron los proyectos de ley presentados en ambas cámaras del Congreso

Nacional argentino hasta diciembre de 2025. Se identificaron en total cincuenta y tres

proyectos relacionados con IA, de los cuales once proponen una ley integral. Sobre estos

últimos se realizó una revisión sistemática. El análisis se estructuró a partir de ocho

elementos clave: definición de IA, establecimiento de principios de la IA, definición de ciclo

de vida, definición inequívoca de seguridad y protección, identificación de categorías de

riesgo, modelo de gobernanza de la IA, tratamiento de incidentes y/o accidentes de IA y

perspectiva proactiva o reactiva con respecto a la seguridad y la protección. Esta matriz

analítica desarrollada por el TecnocenoLab es original y consideramos que es el aporte más

sustantivo de este artículo a futuras investigaciones y discusiones acerca de una política

integral para la IA.

Los datos muestran la necesidad de adoptar un enfoque estatal centrado en la seguridad

sistémica de la IA. Una regulación eficaz debe incorporar definiciones operativas, un ciclo

de vida preciso, taxonomías de riesgo y sistemas de gobernanza robustos, incluyendo

autoridades independientes de investigación, para mitigar peligros y fortalecer la protección

de la sociedad y del orden democrático.

Palabras clave: inteligencia artificial; gestión de riesgos de la IA; ética de la IA seguridad

sistémica; análisis normativo; leyes argentinas.

En el seminario internacional: “La revolución digital, desafíos, riesgos y oportunidades para la seguridad y salud en el trabajo” celebrado en Santiago de Chile y organizado por el Instituto de seguridad laboral, he presentado una propuesta teórica y práctica enfocada en la seguridad y salud aplicada a la inteligencia artificial (IA).

Aquí un abstrac de mi presentación y el video completo.

Revolucion digital.mp4 – Google Drive

La IA debe ser entendida, medida, valorada y gobernada dentro de un marco de referencia específico:

Las IA se define tambien como Metatecnologías que operan y regulan otras tecnologías, funcionando como tecnologías de propósito general que automatizan procesos y facilitan la producción de conocimiento. Además de ser herramientas, son un Mundoambiente y constituyen una Sociedad artificial que acelera la (re) producción de lo social. Por otro lado ética de la IA, según nuestra propuesta, debe complementarse con la ética organizacional y el pensamiento sistémico, considerando el impacto social desde el mismo diseño y por último debido a su naturaleza e impacto, las IA son consideradas Tecnologías de alto riesgo.

Es indudable que la digitalización y automatización presentan oportunidades para mejorar la seguridad y la salud en el trabajo (SST), pero también introducen riesgos potenciales que requieren políticas proactivas. Los riesgos potenciales asociados incluyen accidentes relacionados con fallos mecánicos, ergonomía, ruido y factores psicosociales como la protección de la privacidad, el estrés derivado de la vigilancia continua, la fatiga visual, la sobrecarga cognitiva y el tecnoestrés. Al diseñar un sistema de IA, el desafío fundamental es obtener los recursos para cumplir objetivos de producción y, simultáneamente, salvaguardar el propio sistema y a los usuarios de peligros (externos e internos) durante todo su ciclo de vida.

Las amenazas al sistema pueden clasificarse en Uso Malicioso (intención de daño, como ciberataques o fraudes) y Accidentes (suceso adverso sin intención de daño, provocado por la combinación de factores). Para responder a ellas se propone un enfoque desde la seguridad sistémica (en el sentido del término inglés systemic safety).

La Seguridad Sistémica es un modelo de gestión basado en la teoría de sistemas cuyo objetivo es lograr que los riesgos asociados a los sistemas de IA se reduzcan y controlen a un nivel aceptable. Esta gestión de riesgos debe aplicarse a lo largo de todo el ciclo de vida del sistema, que incluye: Diseño, Prueba, Certificación, Validación, Implementación – Uso, Salida del Mercado. El objetivo es asegurar que el sistema de IA sea puesto en uso con un nivel de riesgo mínimo (probabilidad y severidad de causar daño).

La propuesta Teórico-Práctica que presento incluye:

- La Formación de un equipo interdisciplinario y capacitación en seguridad sistémica aplicada a la IA.

- La Investigación sistémica de accidentes.

- La Aplicación del modelo de industrias ultraseguras y organizaciones de alta fiabilidad (High Reliability Organization HRO), adaptado a la especificidad de la IA.

- La Adopción de estándares internacionales (ISO) y buenas prácticas para garantizar la seguridad y salud del trabajador.

El artículo presenta una herramienta novedosa para la investigación accidentológica:

el mapa de actores clave (MAC). El MAC tiene importantes ventajas para los equipos

de investigación, ya que permite comprender rápidamente el panorama de un suceso

e identificar, desde el inicio del trabajo, quiénes son las organizaciones y personas

involucradas. Así, facilita la obtención de datos y el análisis de accidentes. El trabajo

con MAC ayuda a conocer quiénes (y cómo) pueden contribuir u obstaculizar el logro

de objetivos de las investigaciones de accidentes: transformar la situación bajo estudio,

prevenir nuevos sucesos, fortalecer la seguridad operacional y, finalmente, mejorar el

desempeño del sistema de transporte. Con este objetivo, en primer lugar, se introducirán

algunas nociones claves, luego se definirán los propósitos y las ventajas del MAC

y, por último, se explicará cómo elaborar un MAC y se presentará un ejemplo.

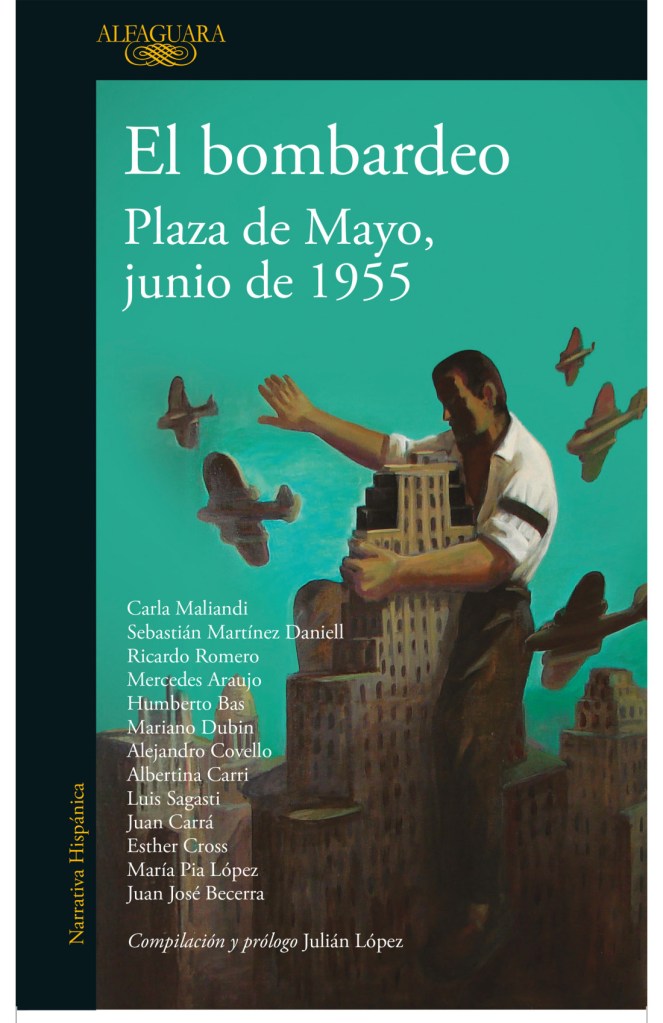

El 16 de junio de 1955, aviones militares bombardearon la Plaza de Mayo con el objetivo de asesinar al presidente Juan Domingo Perón. Llevaban pintadas una V y una cruz que señalaban «Cristo Vence». El resultado fueron cientos de víctimas fatales y una gran cantidad de heridos, todos ellos transeúntes que se habían acercado con la promesa de un desfile aéreo del que lloverían flores. El ataque marcó a fuego la historia argentina y aunque hay intentos de abordaje desde la literatura o el cine, la narrativa sobre este atentado permanece desorganizada, tímida ante la magnitud de sus complejidades. Esta antología reúne a escritoras y escritores dispuestos a conjugar nuevamente la gramática enloquecida de un suceso brutal. A través de crónicas o ficciones, Mercedes Araujo, Humberto Bas, Juan José Becerra, Juan Carrá, Albertina Carri, Alejandro Covello, Esther Cross, Mariano Dubin, María Pia López, Carla Maliandi, Sebastián Martínez Daniell, Ricardo Romeroy Luis Sagasti nos proponen reflexionar sobre esa herida y el consecutivo silencio, meternos en la cicatriz (en esa grieta) que surca la memoria del horror que vibró en casas de familia, clubes barriales, fábricas; comunidades enteras. Abordar la historia, reuniendo sus piezas con audacia, pero también con la fragilidad y la dispersión propias de un recuerdo cada vez más lejano e inasible, traumático y turbulento.

Percy Riberg, Alejandro Covello y Claudio Salvetti

Durante la década de 1970, la industria aeronáutica incorporó la estrategia de seguridad operacional de los factores humanos junto a la capacitación, el entrenamiento y la procedimentación de las habilidades no técnicas (NTS «non-technical skill») con el fin de disminuir los accidentes mayores y mejorar sus estándares de seguridad. Este conjunto de procedimientos se denominó Crew Resource Management (CRM). El objetivo de este trabajo es exponer sintéticamente el origen de la estrategia de los factores humanos y el CRM en la aviación; recorrer su implementación en la industria del gas y petróleo a partir de los documentos 501 y 502 de la IOGP; y finalmente, presentar la iniciativa WOCRM llevada a cabo en YPF.

Flavia Costa, Julián Andrés Mónaco, Alejandro Covello, Iago Novidelsky, Ximena Zabala, Pablo

Rodríguez.

Question/Cuestión, Nro.76, Vol.3, Diciembre 2023

El objetivo de este artículo es ofrecer una perspectiva analítica para comprender y situar en su

dimensión específica los diferentes debates que atraviesan la conversación pública sobre las

Inteligencias Artificiales generativas y los modelos de lenguaje grandes (LLM, por sus siglas en

inglés). En primer lugar, identificamos cinco rasgos de las IA: no son una tecnología, sino que

se trata de metatecnologías; constituyen no un dispositivo técnico, sino un mundoambiente;

pueden ser tecnologías de alto riesgo y requieren de un tratamiento acorde en su ciclo de vida;

las IA generativas y en particular los LLM no son sólo Inteligencia Artificial, sino también

Sociedad Artificial; la perspectiva de la ética de la IA no es suficiente para abordarlas y es

preciso promover un enfoque desde la ética organizacional de la IA y desde el pensamiento

sistémico. En segundo lugar, recortamos las distintas escalas en las que actualmente se

desarrollan las IA: la escala micro, la escala meso (la más propia para situar las políticas

públicas) y la escala macro. En tercer lugar, presentamos dos enfoques transversales para el

abordaje de las IA: el jurídico, orientado a la responsabilidad, y el sistémico, orientado a la

protección y a la seguridad.

Mg. Clara Pierini, Lic. Laura Dobruskin, Lic. Alejandro Covello.

Este artículo realiza un sucinto recorrido por la historia de la metodología propuesta y describe las adecuaciones que realizó la Junta de Seguridad en el Transporte (JST) para aprovechar su potencialidad, tanto para relevar conocimientos como para consolidar aprendizajes en el sistema de transporte argentino.

Accidentes industriales mayores y estados de excepción

En los últimos años, la magnitud de las consecuencias producidas por

los accidentes se ha incrementado en forma paralela con el progreso

tecnológico. Esto trae aparejadas nuevas problemáticas en torno a la

seguridad operacional, que requieren de una apertura cognitiva que

amplíe las competencias de las juntas de investigación de accidentes

hacia eventos excepcionales.

A massacre against indigenous communities in Argentina in 1924 marks the first time an aeroplane was turned into a vehicle to kill civilians in the South American country.

Video by Zorra Media

Executive Producer: Natalia Guerrero

Comparto el video documental de la BBC.com/reel

https://www.bbc.com/reel/video/p0dx0fvm/the-aeroplane-as-an-artefact-of-death